Por Erica Westly

Traducido por Alejandro Ramos de la Peña

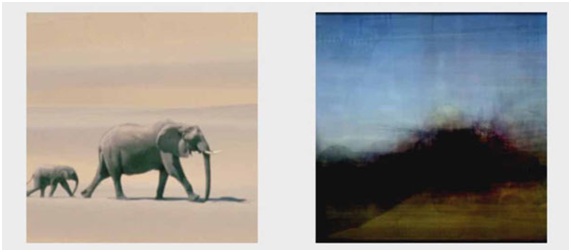

La imagen de la derecha fue reconstruida a partir de una imagen de resonancia magnética funcional obtenida mientras el sujeto vio el video de la izquierda.

La imagen de la derecha fue reconstruida a partir de una imagen de resonancia magnética funcional obtenida mientras el sujeto vio el video de la izquierda.

Los científicos están un paso más cerca de la construcción de una versión digital del sistema visual humano. Investigadores de la Universidad de California, en Berkeley, han desarrollado un algoritmo que puede ser aplicado a imágenes de resonancia magnética funcional (fMRI) para mostrar las imágenes en movimiento que una persona está viendo.

Los neurocientíficos han estado utilizando la fMRI para estudiar el sistema visual humano durante años, el cual implica medir los cambios en los niveles de oxígeno en el cerebro. Esto es muy útil para estudiar la manera en que vemos las imágenes estáticas, pero es poco práctico cuando se trata de imágenes en movimiento. La actividad neuronal individual se produce a gran velocidad, por lo que, desde hace algunos años los investigadores responsables del estudio se concentraron en diseñar un modelo de computadora para medir esto. El estudio muestra que este nuevo enfoque además de ser exitoso, es muy preciso.

Esta tecnología podría ayudar a los investigadores a modelar el sistema visual humano en una computadora. Además, plantea la tentadora perspectiva de que un día se pueda utilizar el modelo para la reconstrucción de otros tipos de imágenes dinámicas, como los sueños y los recuerdos.

Los investigadores involucrados en el estudio observaron durante horas avances de películas mientras estaban recostados en una máquina de fMRI. A continuación, reconstruyeron minuciosamente los datos de manera que encontraron un patrón de activación específico para cada segundo de imagen. Corrieron los datos a través de varios filtros diferentes para deducir lo que estaba ocurriendo a nivel neuronal. «Una vez hecho esto, se tiene un modelo completo que une los conductos de flujo de sangre que se ve con resonancia magnética funcional con la actividad neuronal que no se ve», dice Jack Gallant, coautor del estudio junto a su colega Shinji Nishimoto.

A continuación, los investigadores reunieron una biblioteca de 18 millones de videos de YouTube, elegidos al azar, para poner a prueba su modelo objetivamente. Estudios previos han demostrado que la fMRI puede ser usada para determinar imágenes estáticas mientras el sujeto está mirando, pero el nuevo modelo de computadora ofrece la posibilidad de reconstruir imágenes que tenían movimiento, además de la forma. “Nadie ha intentado modelar previamente una visión dinámica, con este nivel de detalle», dice Jim Haxby, un experto en la neuroimagen en el Dartmouth College, que no participó en el estudio.

Hay dos problemas principales en el estudio. Los investigadores utilizaron datos del fMRI de una sola área del sistema visual, el área V1, también conocida como la corteza visual primaria. Y los modelos fueron adaptados a cada sujeto. El tratar de diseñar un modelo que funcione para todo el mundo habría sido muy difícil, dice Gallant, aunque considera que puede construirse un modelo más generalizado en el futuro.

El objetivo final de esta investigación es crear una versión computacional del cerebro humano que «vea» el mundo como lo hacemos nosotros. El estudio también demuestra un sorprendente uso de la tecnología existente. «Todo el mundo pensaba que era imposible el registro de la actividad cerebral con resonancia magnética dinámica», dice Gallant.

Texto e imagen obtenidos de: